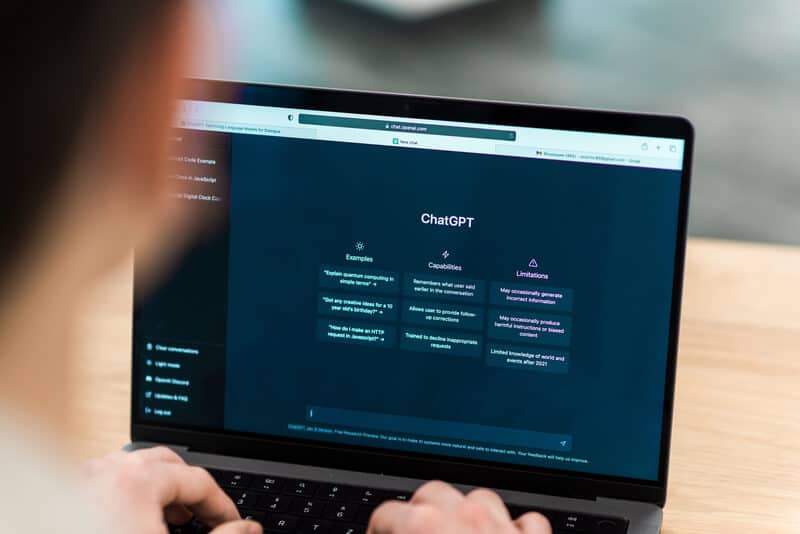

Un prompt ChatGPT, c’est l’instruction claire que vous donnez à ChatGPT pour obtenir le résultat souhaité. Beaucoup découvrent ChatGPT avec enthousiasme, puis décrochent après quelques échanges stériles. Contenus trop lisses, réponses à côté, consignes réécrites dix fois sans résultat satisfaisant : ce schéma revient constamment. Blâmer l’outil est le réflexe naturel, mais rarement le bon. Dans la quasi-totalité des cas, c’est la consigne qui pêche, pas le modèle. Savoir formuler une instruction claire et bien ciblée suffit à transformer l’expérience. Cet article montre concrètement comment y parvenir, dans des situations professionnelles du quotidien.

Prompt ChatGPT : une introduction

Avant d’obtenir des réponses pertinentes avec ChatGPT, encore faut-il comprendre ce qu’est réellement un prompt et comment bien le formuler. Cette notion, souvent sous-estimée, est pourtant la clé pour tirer pleinement parti de l’outil.

Qu'est ce qu'un prompt ChatGPT ?

Le mot prompt vient de l’anglais et signifie « incitation » ou « amorce ». Concrètement, c’est ce que vous tapez pour lancer une conversation avec ChatGPT :

- Question

- Consigne

- Demande

Cela peut tenir en une phrase comme en plusieurs lignes, selon ce que vous cherchez à obtenir. Plus l’instruction est claire et précise, plus la réponse sera utile.

Pourquoi votre façon de poser les questions change tout

Soumettre une consigne à ChatGPT n’a rien d’une conversation intuitive où l’interlocuteur devine ce qu’on sous-entend. Chaque mot compte et oriente le résultat dans une direction précise. Une instruction mal formulée ne produit pas une mauvaise réponse par hasard : elle produit exactement ce qu’elle annonçait, c’est-à-dire quelque chose d’imprécis. À l’inverse, une consigne bien construite réduit considérablement la marge d’interprétation du modèle. Ni talent particulier ni formation technique ne sont requis : juste une méthode appliquée avec constance, qui s’affine naturellement au fil des échanges.

L'IA ne lit pas dans vos pensées

Ce que vous n’écrivez pas dans votre consigne, ChatGPT l’ignore totalement. Votre métier, vos habitudes de travail, le public que vous visez, les contraintes propres à votre projet : aucun de ces éléments n’est accessible au modèle sans que vous les mentionniez explicitement. Une réponse décevante traduit presque toujours ce manque d’informations transmises. Préciser votre secteur d’activité, le profil de votre destinataire ou le format attendu réduit la marge d’interprétation du modèle. Sans ce cadrage, il génère du contenu standard, valable pour n’importe qui, donc réellement utile pour… personne.

Ce qui se passe vraiment quand vous soumettez un prompt

ChatGPT prédit et ne réfléchit pas au sens où un expert humain réfléchit. À partir de milliards de textes traités lors de son entraînement, il calcule quelle suite de mots semble la plus cohérente avec votre consigne. Ce fonctionnement par prédiction statistique explique pourquoi le choix de chaque terme dans votre instruction pèse réellement sur le résultat obtenu. Glisser un mot imprécis ouvre la porte à une réponse tout aussi imprécise. Formuler une instruction structurée avec des paramètres clairs oriente le modèle vers quelque chose de nettement plus exploitable et conforme à votre besoin initial.

Même outil, résultats opposés : pourquoi ?

À tâche égale, deux utilisateurs de ChatGPT peuvent obtenir des résultats sans aucun rapport. Ce n’est pas une question de chance. Celui qui repart avec quelque chose d’utilisable a pris le temps de :

- Préciser son contexte

- Définir le format voulu

- Indiquer à qui le contenu s’adresse

- Ajuster la consigne quand le premier résultat manquait sa cible.

L’autre a posé une question en cinq mots en espérant un livrable clé en main. Formuler des instructions précises n’est pas inné, mais c’est une habitude qui s’installe vite et qui change durablement la façon dont on travaille avec l’outil.

Anatomie d'un bon prompt : les éléments qui font la différence

Derrière une consigne qui fonctionne, il y a toujours une même logique : donner à ChatGPT suffisamment de matière pour qu’il n’ait pas à inventer ce qui manque. Rôle, contexte, objectif, format, ton : chacun de ces éléments oriente la réponse vers quelque chose d’utile. En négliger un seul, et le modèle comble le vide à sa façon. Le résultat arrive, mais il ne correspond à rien de précis. Comprendre ce qui compose une bonne consigne, c’est cesser de reformuler en boucle et gagner du temps sur chaque échange.

Le rôle : pourquoi donner une identité à l'IA

Sans indication de rôle, ChatGPT répond comme s’il s’adressait à n’importe qui. Lui attribuer une fonction précise change immédiatement le registre, le niveau de détail et l’angle choisi. Un juriste spécialisé en droit social n’aborde pas les mêmes aspects qu’un formateur RH sur un sujet identique, et ChatGPT reproduit exactement cette logique. Le rôle conditionne aussi la façon dont les notions sont traitées : un expert va droit au fond sans reformuler les bases, là où un pédagogue vulgarise et illustre. Définir qui parle oriente directement ce qui sera dit.

Le contexte : l'ingrédient le plus sous-estimé

ChatGPT ignore tout de votre secteur, de votre public et de vos contraintes internes. Sans contexte fourni, il produit une réponse acceptable dans l’absolu, inutilisable dans les faits. Quatre informations suffisent généralement à transformer le résultat :

- Secteur d’activité concerné

- Profil du destinataire visé

- Objectif final de la démarche

- Contraintes spécifiques à respecter

Plus ces éléments sont précis dans la consigne, moins le modèle interprète à sa guise, et plus le contenu produit se rapproche d’un livrable directement exploitable sans retravail.

L'objectif : formuler ce qu'on attend vraiment

Avant d’écrire quoi que ce soit, clarifier mentalement ce qu’on attend du modèle évite bien des reformulations inutiles. Un objectif mal défini engendre une consigne vague, qui elle-même produit une réponse peu exploitable. Le choix du verbe d’action structure déjà la réponse à venir : résumer, comparer, reformuler, structurer, analyser. Chacun oriente ChatGPT différemment sur le même sujet. Prendre trente secondes pour préciser l’action attendue avant d’écrire la consigne réduit sensiblement le temps passé à corriger un résultat approximatif.

Le format : guider la forme du résultat

ChatGPT peut restituer un même contenu sous des formes très variées :

- Texte continu

- Tableau comparatif

- Liste hiérarchisée

- Plan numéroté ou balisage Markdown prêt à intégrer dans un CMS

Sans indication de format, le modèle choisit seul, souvent de façon inadaptée au contexte d’utilisation. Préciser la forme attendue dès la consigne supprime une étape de mise en forme manuelle souvent chronophage. Quelques exemples concrets d’usages :

- Tableau pour mettre en regard plusieurs options

- Paragraphes courts pour un post sur les réseaux sociaux

- Plan structuré pour préparer une intervention orale

Les erreurs de prompt les plus fréquentes (et comment les corriger)

ChatGPT ne lit pas entre les lignes. Il travaille uniquement avec ce qu’on lui écrit, mot après mot, sans deviner ce qu’on sous-entend. Une consigne bancale ne produit pas une mauvaise réponse par accident : elle produit exactement ce qu’elle méritait, c’est-à-dire quelque chose de creux et d’inutilisable. Repérer les erreurs les plus communes dans la formulation des consignes suffit souvent à transformer radicalement la pertinence des réponses obtenues.

Trop court, trop vague : le piège du prompt "paresseux"

Quand une consigne tient en quatre mots, ChatGPT bouche les trous à sa façon. Le résultat ressemble à tout et ne sert vraiment personne. Des formulations comme « donne-moi des idées de posts » ou « explique ce sujet » n’indiquent ni destinataire, ni format, ni contexte. Voyez la différence concrète :

- Flou : « Propose des idées de contenus pour Instagram. »

- Cadré : « Tu es spécialiste en marketing digital. Génère huit idées de posts Instagram pour une école de cuisine parisienne, ciblant des passionnés de gastronomie de 30 à 55 ans. Précise pour chacune le format visuel recommandé. »

Trente secondes de rédaction supplémentaires, résultat directement exploitable.

Trop long, trop chargé : quand le prompt noie l'IA

Accumuler les demandes dans une seule consigne produit des réponses qui survolent tout sans creuser quoi que ce soit. ChatGPT ne sait plus quoi traiter en priorité et disperse son traitement sur plusieurs angles à la fois. La règle tient en peu de mots : une consigne, une tâche. Dès qu’un besoin implique plusieurs livrables distincts, mieux vaut enchaîner des consignes courtes et ciblées plutôt que d’empiler les instructions dans un bloc indigeste. Cette discipline améliore la profondeur des réponses obtenues à chaque étape.

L'absence de contraintes : laisser trop de liberté

Sans balises précises, ChatGPT produit une réponse calibrée pour convenir à tout le monde, donc à personne en particulier. Les contraintes ne limitent pas l’outil, elles l’orientent vers ce dont on a véritablement besoin. Quatre paramètres changent sensiblement le résultat :

- Ton attendu : sobre, didactique, direct

- Longueur approximative souhaitée

- Structure de la réponse

- Vocabulaire à privilégier ou à bannir

Une consigne qui précise « quatre paragraphes, exemples chiffrés, sans anglicismes » produit un résultat sans commune mesure avec la même demande formulée sans ces indications.

Oublier d'itérer : croire que le premier jet est le bon

La première réponse de ChatGPT est un point de départ, rarement un livrable final. L’outil révèle sa vraie valeur dans l’échange progressif, quand on ajuste au fil des retours plutôt que d’envoyer une consigne unique en espérant un résultat parfait. Concrètement, itérer peut prendre plusieurs formes :

- Resserrer ou développer un passage précis

- Corriger le registre ou le niveau de langue

- Reformuler la structure pour coller au format attendu

Les utilisateurs qui obtiennent les meilleurs résultats ne cherchent pas le prompt idéal dès le départ. Ils construisent par étapes successives, en affinant à chaque échange.

Techniques concrètes pour affiner vos prompts

Derrière chaque réponse décevante de ChatGPT se cache presque toujours une consigne mal construite. Ce n’est pas l’outil qui flanche, c’est l’instruction qui pêche. Pourtant, 80 % des professionnels perdent plus de temps à reformuler leurs demandes qu’à travailler sur les résultats obtenus (HubSpot, 2024). Quatre techniques changent concrètement la donne. Aucune ne demande de compétences particulières : juste un peu de méthode appliquée dès les premières lignes de la consigne.

Le prompting en plusieurs étapes (chain prompting)

Demander trop à la fois produit des réponses larges mais creuses. Mieux vaut avancer par paliers : une première consigne pose les bases, la suivante approfondit un point précis, et ainsi de suite jusqu’au résultat voulu. Sur un rapport d’analyse sectorielle, par exemple, on commence par bâtir le plan, on traite ensuite chaque partie l’une après l’autre, puis on demande une introduction qui coiffe l’ensemble. Procéder ainsi évite les développements bâclés qu’entraîne systématiquement une demande formulée en bloc, d’un seul tenant.

Demander à l'IA de reformuler votre prompt elle-même

Certaines demandes sont difficiles à formuler clairement du premier coup. Plutôt que de tourner en rond, soumettez une version approximative et ajoutez simplement : « Réécris cette consigne pour la clarifier, en gardant exactement ce que je veux obtenir. » ChatGPT restructure alors la demande, souvent bien mieux que ce qu’on aurait écrit soi-même. Répété régulièrement, cet exercice apprend aussi à repérer ce qui rend une consigne solide : niveau de détail, cadrage du ton, précision de l’objectif visé.

Utiliser des exemples dans la consigne

Un exemple intégré dans la consigne vaut dix lignes d’explications. Cette technique, dite few-shot prompting, montre au modèle ce qu’on attend plutôt que de le lui décrire. Voyez la différence :

- Sans cadre : « Écris un texte sur l’intelligence artificielle en entreprise. »

- Avec modèle : « Rédige une tribune de 400 mots sur l’adoption de l’IA dans les PME françaises, ouverte sur un constat chiffré, développée en trois angles distincts, conclue sur une recommandation pratique. Registre professionnel, sans jargon technique. »

Le premier prompt laisse tout ouvert. Le second ferme les mauvaises portes sans brider la créativité.

Jouer sur le ton, le registre et le public cible

Un même sujet traité pour un directeur financier, un responsable RH ou un apprenti ne donnera jamais le même texte si la consigne précise à qui il s’adresse. ChatGPT ajuste le vocabulaire, la densité d’information et la structure en fonction du destinataire indiqué. Sans cette précision, le modèle choisit seul, souvent de façon trop générique. Trois paramètres font toute la différence :

- Profil précis du lecteur visé

- Support de publication ou de diffusion

- Registre attendu : didactique, analytique, incitatif ou neutre

Privilégiez une syntaxe cassée, des tournures journalistiques, sans lisser chaque phrase.

Techniques de prompt dites RCT et CARTEL

Parmi les méthodes qui ont fait leurs preuves, deux sortent du lot. La méthode RCT repose sur trois piliers : Rôle, Contexte, Tâche. Simple et rapide, elle répond à 80 % des besoins du quotidien. La méthode CARTEL va plus loin en ajoutant l’Audience, des Exemples et un Livrable précis, utile quand le résultat doit être utilisable sans retouche.

Changements qu'impliquent les évolutions de modèles

Chaque génération modifie en profondeur la manière de rédiger une consigne. GPT-3 et GPT-3.5 réclamaient des instructions très détaillées pour sortir quelque chose d’utilisable. GPT-4 a changé la donne : le contexte passe mieux, le cadrage devient moins indispensable. GPT-4o et les modèles o3 ont resserré encore le raisonnement, des prompts plus courts suffisent, à condition de viser juste. GPT-4.1 et GPT-5 vont plus loin, capables de s’adapter à presque n’importe quel type de tâche.

Prompts pratiques par métier : des exemples directement réutilisables

Formuler une bonne consigne, ça s’apprend en dix minutes et ça change tout ce qu’on obtient de ChatGPT. Aucune compétence informatique n’entre en jeu. Ce qui fait la différence, c’est simplement d’écrire une instruction assez précise pour que le résultat arrive prêt à l’emploi. Quatre domaines professionnels sont passés en revue, avec des exemples de consignes directement réutilisables. Quelques retouches suffisent selon le contexte, pas besoin de repartir de zéro à chaque fois.

Vous cherchez à utiliser ChatGPT de façon structurée et sans prendre de risques inutiles ? La formation ChatGPT : domptez l’IA en toute sécurité couvre tout le parcours, des premières consignes jusqu’aux applications professionnelles les plus poussées.

Pour les équipes marketing et communication

Un brief marketing flou produit un contenu creux. Avec ChatGPT, même logique : si la consigne ne précise pas à qui s’adresse le message, sur quel canal et dans quel registre, le résultat sera trop générique pour servir à quoi que ce soit. Essayez plutôt : « Tu travailles comme consultant en stratégie éditoriale pour une marque de cosmétiques naturels. Écris cinq descriptions produits pour une crème hydratante, destinées à des femmes de 40 à 60 ans soucieuses de la composition. Maximum 80 mots par description, ton rassurant et factuel. » Résultat exploitable dès la première lecture, sans réécriture.

Pour les RH et managers

Certains documents RH reviennent régulièrement sans jamais vraiment changer de structure : grilles d’évaluation, supports d’entretien, plans d’intégration. ChatGPT les génère en quelques secondes si on lui donne le cadre. Par exemple : « Tu es DRH dans une entreprise de logistique de 300 salariés. Construis une grille d’évaluation de période d’essai pour un poste de responsable d’entrepôt, articulée autour de quatre dimensions : maîtrise opérationnelle, organisation du travail, posture managériale et communication interne. Questions ouvertes uniquement. » Le résultat s’intègre directement dans un processus RH existant.

Pour les indépendants et consultants

La rédaction prend du temps que les indépendants n’ont pas toujours. Propositions commerciales, notes de cadrage, emails de prospection : ChatGPT produit ces documents rapidement, à condition que la consigne reflète un contexte métier précis.

Deux exemples à adapter :

- « En tant que consultant en management interculturel, rédige un message de prospection pour un DRH d’un Groupe d’entreprise agroalimentaire présente dans cinq pays, autour d’une offre de cohésion d’équipes multiculturelles. Registre professionnel, 100 mots. »

- « Tu es consultant en performance commerciale. Rédige le plan détaillé d’une note de cadrage pour un client voulant structurer sa force de vente : état des lieux, axes prioritaires, plan d’actions, indicateurs clés et prochaines étapes. »

Pour les formateurs et équipes pédagogiques

Préparer un cas pratique ou concevoir une séquence pédagogique from scratch (de toutes pièces) prend du temps. ChatGPT en récupère une bonne partie, à condition de lui indiquer clairement le niveau du groupe et ce que les participants doivent savoir faire après la formation.

Deux exemples concrets :

- « Tu es formateur en prise de parole en public pour des ingénieurs en début de carrière. Rédige une mise en situation fictive d’une vingtaine de lignes autour d’une présentation technique ratée devant un comité de direction. Ajoute quatre questions de réflexion pour le débriefing collectif. »

- « En tant que concepteur pédagogique, propose un plan de formation d’une journée sur la gestion du changement pour des managers de proximité, avec objectifs comportementaux, séquences d’activités et modalités d’évaluation. »

Un bon prompt ne fait pas tout : ce qu'il faut garder en tête

Savoir formuler une bonne consigne améliore les résultats, sans pour autant les rendre infaillibles. ChatGPT fonctionne sur des bases statistiques : deux consignes quasi identiques peuvent produire des réponses sensiblement différentes. Cette variabilité est inhérente au fonctionnement du modèle. Maintenir une lecture attentive de chaque réponse obtenue n’est pas une précaution excessive, c’est simplement ce qu’exige un usage professionnel rigoureux.

ChatGPT ne vérifie pas, il génère

Beaucoup d’utilisateurs l’ignorent encore : ChatGPT ne consulte aucune source pour formuler ses réponses. Il produit du texte vraisemblable, construit à partir de patterns statistiques, sans aucun mécanisme de vérification factuelle intégré. Une affirmation inexacte sera présentée avec la même fluidité qu’une information juste. Ce glissement, souvent appelé hallucination, touche aussi bien les dates que les chiffres, les citations ou les références légales. Tout contenu impliquant des données sensibles doit être vérifié de manière indépendante avant d’être utilisé ou transmis.

Le prompt parfait n'existe pas

Chercher la formulation idéale conduit souvent à une perte de temps considérable. Les modèles de langage ne fonctionnent pas comme des moteurs de recherche auxquels on soumettrait la bonne requête pour obtenir le bon résultat. Une légère variation dans la tournure d’une phrase peut changer l’orientation complète d’une réponse. Ce qui compte vraiment, c’est d’acquérir des réflexes :

- Poser des consignes claires

- Lire les résultats avec esprit critique

- Corriger au fil des échanges plutôt que d’attendre une réponse parfaite dès le premier essai

L'humain reste le décideur final

ChatGPT ignore tout des tensions internes à votre organisation, des relations en jeu dans un dossier délicat ou des subtilités propres à votre secteur d’activité. Il peut produire une trame, suggérer une formulation ou organiser des idées, mais la validation du fond reste une responsabilité qui ne se délègue pas. Publier ou transmettre un contenu sans l’avoir relu expose à des :

- Erreurs factuelles

- Approximations juridiques

- Formulations inadaptées au contexte

La vigilance n’est pas optionnelle dès lors que le contenu produit engage votre nom ou celui de votre structure.

Conclusion

Rédiger un prompt efficace n’est pas réservé aux profils techniques : c’est une méthode qui s’apprend, pas un don inné. Contexte, rôle, objectif, format, contraintes – chaque composante oriente ChatGPT vers une réponse réellement exploitable. Ce qui sépare l’utilisateur qui obtient satisfaction du premier coup de celui qui reformule en boucle, c’est rarement la maîtrise de l’outil : c’est la rigueur de la consigne. Structurer avant d’envoyer, tester des variantes, ajuster progressivement – ces habitudes transforment en profondeur la qualité des échanges. ChatGPT reste un assistant, jamais un arbitre. Évaluer ce qu’il produit et identifier ce qui mérite correction fait partie intégrante de la maîtrise du prompting.

Envie de construire des prompts qui donnent vraiment satisfaction ? La formation ChatGPT : de l’IA qui ne mord pas à l’IA qui répond à tout est faite pour ceux qui veulent arrêter de tâtonner et prendre enfin le contrôle de l’outil.

Vous êtes à la recherche de solutions en IA qui contribuent au développement des compétences de vos collaborateurs ? Nous vous invitons vivement à consulter nos programmes de formations en intelligence artificielle !

EXCELLENTTrustindex verifies that the original source of the review is Google. Je recommande vivement Quality Training pour le niveau de ses formations. Les formateurs sont professionnels et experts en la matière, de plus la pédagogie toujours au rdv.Posted onTrustindex verifies that the original source of the review is Google. Préparation des formations en amont, suivi et dispenses d''excellente qualité. Nos participants sont ravis et les organisateurs également.Posted onTrustindex verifies that the original source of the review is Google. En tant que client, je trouve que Quality Training réussit à mettre en place des formations adaptées aux demandes et aux besoins!Posted onTrustindex verifies that the original source of the review is Google. Excellente formation où j ai appris énormément en peu de temps, axée sur des informations pratiques et rapidement utilisables en milieu professionnel.Posted onTrustindex verifies that the original source of the review is Google. Quality Training prend vraiment soins de ses clients, écoute ses besoins pour donner des formations de qualité dans une très bonne ambiance ! Merci QTPosted onTrustindex verifies that the original source of the review is Google. Travaillant au sein du service Formation et Développement de la Croix-Rouge, nous faisons régulièrement appel à Quality Training. Formations intéressantes, adaptées aux besoins de nos équipes et sur mesure. Formateurs disponibles et très sympathiques. Prise de contact avec Marie toujours très rapide et professionnelle, je recommande.Posted onTrustindex verifies that the original source of the review is Google. Très bonne collaboration avec notre entreprise : que ce soit au niveau de la qualité des formateurs ou du suivi avant et après session de formation. Un organisme très professionnel que nous recommandons.

Ils se sont formés avec Quality Training

Ils nous font confiance au quotidien, serez-vous le prochain ?

FAQ

Qu’est-ce qu’un prompt ?

Un prompt, c’est simplement ce qu’on écrit à ChatGPT pour lui indiquer ce qu’on attend de lui. Selon la façon dont cette instruction est rédigée, le résultat sera exploitable ou complètement à côté. Les questions qui reviennent le plus souvent sur ce sujet trouvent leurs réponses ci-dessous.

Un prompt court peut-il donner un bon résultat ?

Oui, à condition qu’il soit précis et ciblé. La longueur n’est pas le critère déterminant : une consigne brève mais bien construite surpasse une instruction longue et confuse. L’objectif, le contexte et le format attendu doivent rester lisibles, même en peu de mots. Ce qui compte, c’est la clarté de l’intention exprimée, pas le volume de texte produit.

Faut-il réécrire son prompt à chaque nouvelle conversation ?

Non, mais il faut l’adapter au contexte. Un prompt performant peut tout à fait être réemployé, à condition d’ajuster le secteur d’activité, le ton ou l’objectif visé. Repartir systématiquement de zéro est contre-productif : mieux vaut conserver une base solide et la modifier selon les besoins spécifiques de chaque situation.

Peut-on sauvegarder ses prompts efficaces quelque part ?

ChatGPT ne propose aucun système natif d’organisation ou de nommage des prompts. La méthode la plus accessible consiste à les regrouper dans un document externe (note, tableur ou fichier texte) classés par usage ou par thématique. Certaines extensions de navigateur permettent également de gérer une bibliothèque de prompts directement depuis l’interface de ChatGPT.

Est-ce qu'un prompt en français donne de moins bons résultats qu'en anglais ?

Non. Une étude menée par des chercheurs de l’université du Maryland et de Microsoft a évalué les performances de plusieurs modèles d’IA sur 26 langues : l’anglais arrive en sixième position, le français en deuxième (université du Maryland / Microsoft). Les utilisateurs francophones n’ont aucune raison de basculer vers l’anglais pour améliorer la qualité des réponses obtenues.

Comment savoir si mon prompt est vraiment bon ?

Un prompt efficace repose sur trois critères :

- Clarté de l’intention exprimée

- Précision du contexte fourni

- Format de sortie explicitement défini

Si la réponse obtenue correspond au besoin sans reformulation majeure, le prompt était bien construit. Dans le cas contraire, identifiez l’élément manquant (contexte, contraintes, objectif) et ajustez en conséquence.

ChatGPT comprend-il le contexte d'une conversation précédente ?

Oui, dans une certaine mesure. ChatGPT peut mémoriser des éléments issus d’échanges antérieurs – préférences, centres d’intérêt – et les mobiliser pour affiner ses réponses ultérieures. Cette fonctionnalité reste cependant limitée et ne dispense pas de recontextualiser la demande dès qu’un nouveau sujet ou une nouvelle tâche est abordé.